Llegeixes el resum que ofereix la IA de Google? Comet 75 milions d’errors cada hora, segons un estudi

Una investigació del ‘The New York Times’ conclou que el 10% de les respostes de la ‘AI Overview’ són errònies

Una investigació del ‘The New York Times’ conclou que el 10% de les respostes de la ‘AI Overview’ són errònies

Fer una cerca a Google i quedar-se amb la primera opció que apareix no ha estat mai garantia d’obtenir la millor informació, ja que l’ordre dels resultats depèn de factors com la publicitat o el SEO, no de la qualitat de la informació. Ara ho és encara menys, ja que el primer resultat sovint ja no és una pàgina web, sinó un resum generat per Gemini, la intel·ligència artificial de Google.

Una de cada deu respostes generades per la funció AI Overview de Google comet errors, tal com evidencia una investigació recent del The New York Times. Que la IA s’equivoqui no és cap novetat, però ara el diari estatunidenc hi posa xifres i evidencia un volum considerable d’imprecisions: aproximadament, 500.000 milions d’errors a l’any, 1.369 milions al dia o 75 milions cada hora.

L’estudi es basa en una anàlisi encarregada a la startup d’intel·ligència artificial Oumi, que ha avaluat la precisió de les respostes de Google analitzant 4.326 cerques en dues fases diferents: primer, amb el model Gemini 2 i, després, amb la seva versió actualitzada, Gemini 3. Els resultats mostren que les respostes són correctes en aproximadament el 85% dels casos amb Gemini 2 i en el 91% amb Gemini 3.

Què són les AI Overview?

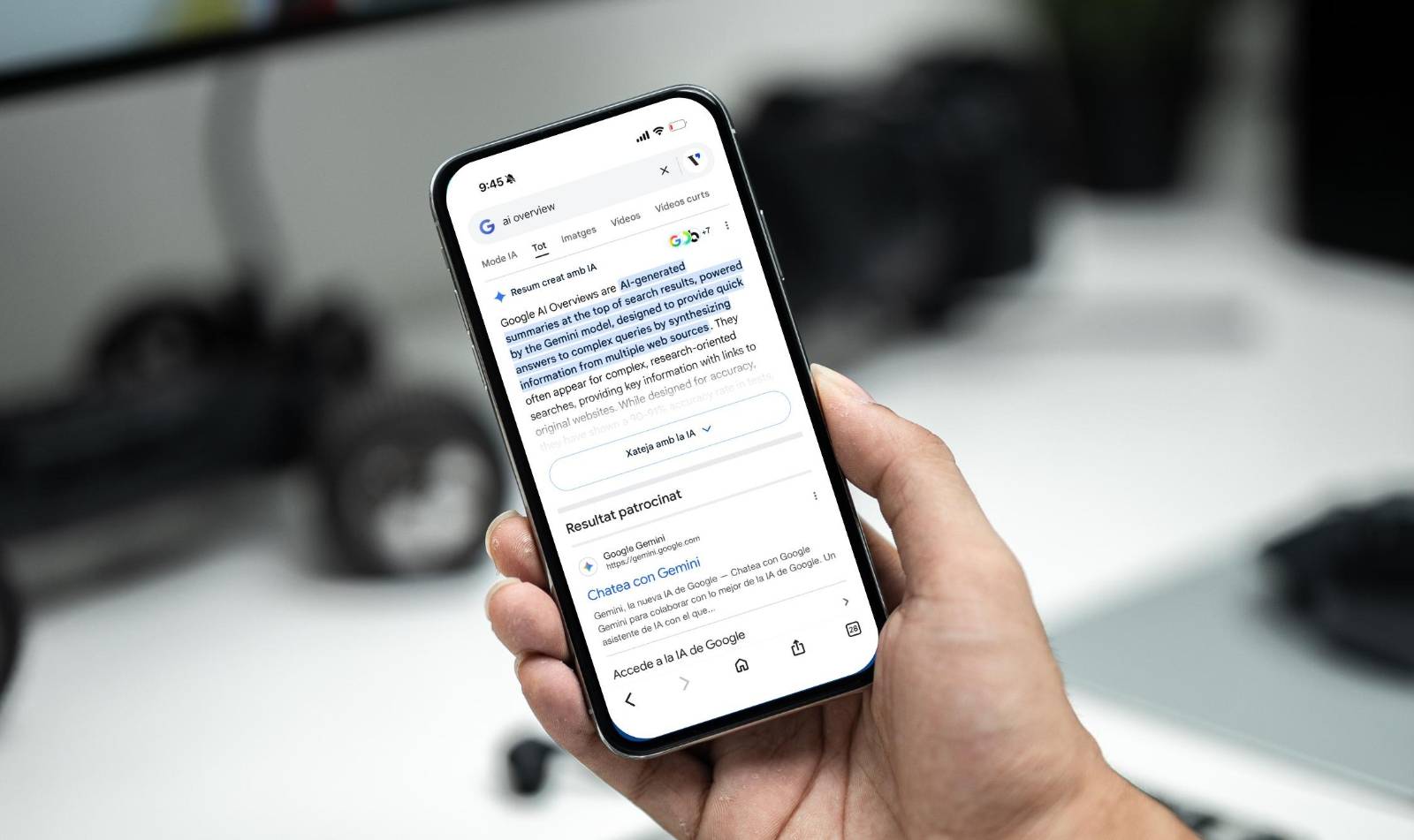

Les AI Overview (AIO, per les seves sigles en anglès) són resums generats automàticament per models d’intel·ligència artificial (concretament, per Gemini) a partir de la informació extreta de diversos llocs web. Aquest contingut es mostra destacat a la part superior dels resultats de cerca, per sobre dels enllaços tradicionals. No es tracta d’una funcionalitat opcional: apareix de manera automàtica en determinades cerques i forma part del funcionament habitual del cercador.

A Espanya, les AIO s’activen en el 28,9% de les cerques analitzades. És a dir, gairebé tres de cada deu consultes mostren un resum sintètic abans dels resultats orgànics tradicionals. Així ho evidencia l’estudi “L’impacte d’AI Overview als mitjans espanyols” de la Universitat de Barcelona (pendent de publicació). En un context més global, alguns informes apunten a percentatges que se situen per sobre del 20%, però altres indiquen que poden arribar fins al 50%.

Fonts poc fiables i respostes contradictòries

La investigació del The New York Times detecta problemes rellevants en els resums d’IA pel que fa a les fonts: més de la meitat de les respostes correctes no estan ben fonamentades (concretament, el 56% amb el model Gemini 3, el més avançat). Això vol dir que els enllaços proporcionats no recullen completament la informació que s’hi presenta.

Exemple que il·lustra la investigació

A més, la investigació apunta que les fonts utilitzades no sempre són fiables. Plataformes com Facebook o Reddit apareixen sovint entre les referències, també en respostes incorrectes. A més, el sistema pot generar respostes dispars per a una mateixa consulta en moments diferents, fet que en dificulta la verificació.

En aquesta línia, al gener d’enguany, The Guardian ja va publicar en una investigació pròpia sobre els resultats enganyosos que aquests resums ofereixen en temes salut. Després d’aquesta investigació, Google va decidir eliminar els resultats per a les cerques “quin és el rang normal per a les anàlisis de sang del fetge” i “quin és el rang normal per a les proves de funció hepàtica”. Ambdues, consultes que la recerca del diari britànic havia demostrat errònies.

AI Overview no és el mateix que el “mode IA”

El cercador de Google també té una altra opció que fa servir la IA: el mode IA. Disponible a Espanya des del passat octubre, es tracta d’una funcionalitat que ofereix una experiència més conversacional a l’usuari, tal com exposa Google al seu web, amb un funcionament més semblant als xatbots.

En aquest cas, no apareix automàticament a la part superior de la pàgina de respostes, sinó que està disponible a la barra d’eines del cercador. Google assegura al seu Centre d’Ajuda que sempre “es verifica la informació en més d’un lloc” però, com qualsevol model d’IA, “pot no brindar respostes encertades”.

Per què fallen aquests sistemes d’IA?

Segons explica Google, tant les AI Overviews com el mode IA no funcionen amb un únic sistema tancat, sinó que combinen diferents models i tècniques. Això fa que les respostes puguin variar en funció de la consulta i del moment, sense seguir un patró fix.

La investigació del New York Times apunta al mateix funcionament dels sistemes d’intel·ligència artificial. Tal com recull el diari, aquests models “fan servir probabilitats matemàtiques per endevinar la millor resposta, no un conjunt estricte de regles definides per enginyers humans”. Això implica que, per definició, sempre hi haurà un cert marge d’error, tal com hem explicat.

A més, l’estudi detecta que els errors no només provenen de fonts poc fiables, sinó també de la manera com la IA interpreta la informació. En alguns casos, el sistema és capaç d’identificar fonts correctes, però en fa una lectura errònia o incompleta. Casos com els assenyalats per Full Fact, que ha advertit que els fragments automàtics poden desinformar, o per The Verge, que ha denunciat canvis en titulars que en distorsionen el sentit, exemplifiquen com aquestes tecnologies poden alterar el significat original de la informació fins i tot quan parteixen de fonts fiables.