Falsos médicos hechos con IA inundan YouTube con desinformación dirigida a personas mayores

Verificat ha analizado cerca de un millar de vídeos generados con IA de canales que se hacen pasar por médicos especializados en envejecimiento; el 74% no tienen la etiqueta sobre cómo han sido hechos

Verificat ha analizado cerca de un millar de vídeos generados con IA de canales que se hacen pasar por médicos especializados en envejecimiento; el 74% no tienen la etiqueta sobre cómo han sido hechos

El artículo se ha actualizado para incluir declaraciones de la Comisión Europea (a 20 de marzo) y de YouTube (a 25 de marzo)

YouTube está lleno de canales de salud realizados con inteligencia artificial. Nada prueba que detrás hay médicos reales. Sin embargo, los canales no indican en su descripción que producen contenido sintético, y tres de cada cuatro vídeos que publican tampoco lo especifican, aunque las políticas de la plataforma piden a los creadores que lo hagan. Es la conclusión de un estudio de Verificat después de analizar 14 canales y el casi millar de vídeos que han producido con estas características.

Todos ellos están dirigidos a personas mayores y, a menudo, contienen información no basada en la evidencia y desinformación que en algunos casos ya hemos desmentido desde Verificat, como alimentos milagrosos, consejos sin evidencia para prevenir enfermedades, o recomendaciones para evitar tratamientos indicados.

En conjunto, los canales investigados acumulan más de medio millón de seguidores y 54 millones de visualizaciones. Se trata de perfiles recientes (ninguno tiene más de un año de antigüedad) y muy similares entre ellos, donde aparecen personas (simuladas) con bata blanca que se presentan como doctores expertos en salud y envejecimiento, y comparten supuestos hábitos para prevenir enfermedades.

Son contenidos que podrían vulnerar las políticas de la plataforma. Además, la Digital Services Act (DSA) de la Unión Europea requiere que todos los proveedores de grandes plataformas online identifiquen, analicen y evalúen diligentemente cualquier riesgo sistémico real o previsible en relación con la salud pública, y las graves consecuencias negativas que pueden provocar en el bienestar físico y mental de las personas.

Desde Verificat, pusimos la investigación en conocimiento de YouTube el 11 de marzo de 2026 para pedirles qué acciones llevan a cabo frente a estos contenidos. A través del departamento de prensa, un portavoz de YouTube nos ha contestado a fecha 25 de marzo explicando las medidas aplicadas en los canales reportados por Verificat que incluyen añadir etiquetas de IA a alrededor de 700 vídeos que no la tenían, cerrar uno de los 14 canales que infringía la política de spam, prácticas engañosas y estafas, y eliminar un nombre de canales indeterminados del Programa de socios de YouTube, lo que significa que ya no pueden obtener ingresos del contenido.

La investigación de Verificat se ha centrado en 14 perfiles que aseguran haber sido creados en España, pero los deepfakes de profesionales de la salud es una tendencia que traspasa fronteras y lenguas, como han puesto de manifiesto otros miembros, como Verificat, de la red europea de fact-checking EFCSN como Full Fact o Science Feedback.

Un millar de vídeos de doctores hechos con IA

A través del WhatsApp de Verificat (+34 695 225 233), nos llegó un vídeo corto de YouTube de un supuesto médico de Perú que recomendaba el consumo de plátano en mayores de sesenta años describiéndolo como un “alimento milagroso”, un concepto que no existe. Tenía indicios de estar generado con IA, aunque no llevaba ninguna etiqueta que lo indicara. El autor del canal se presentaba como doctor y compartía «contenido pensado especialmente para gente mayor» con remedios naturales «para la diabetes, colesterol, presión alta, hígado graso y más».

A partir de una búsqueda de estos conceptos, desde Verificat hemos localizado decenas de canales similares creados en YouTube desde todo el mundo. Un análisis en profundidad de 14 de estas cuentas con origen declarado en España ha demostrado que se trata de falsos doctores generados con inteligencia artificial. Todos publican de forma sistemática contenidos de salud dirigidos a personas mayores (nueve explicitan que están destinados a “mayores de 60 años”, y otros tres hablan de “personas mayores”, “tercera edad” o “salud sénior”), en muchos casos sin base científica ya menudo con desinformación y alarmismo, fet que pot tenir un impacte real en la vida i la salut de les persones.

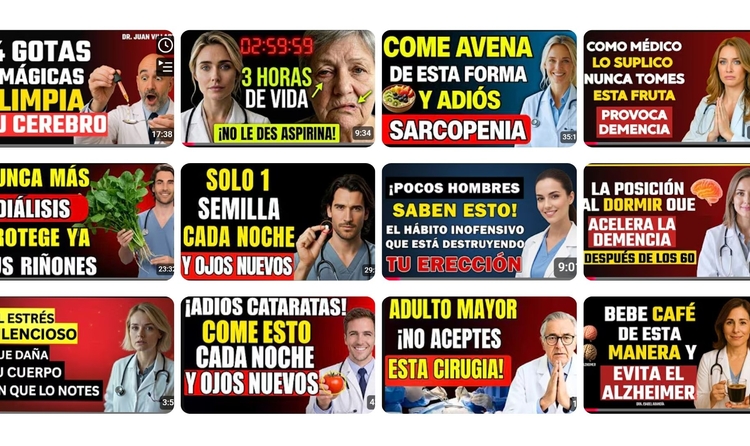

Capturas de algunos vídeos de las cuentas analizadas por Verificat. La muestra incluye 14 cuentas, que han publicado cerca de un millar de vídeos que acumulan 54 millones de visualizaciones.

En todos los casos, los vídeos presentan consejos genéricos, y hablan a menudo de alimentos “milagrosos”. Verificat ya ha desmontado algunas de las desinformaciones que aparecen en estos canales con anterioridad: es el caso del falso mito de que la ducha con agua fría aumenta el riesgo de sufrir un ictus u otras enfermedades cardiovasculares, o que la chia no es un superalimento que permite curar o prevenir enfermedades por sí solo. Por otra parte, también hay casos en los que recomiendan no seguir determinados tratamientos, vacunas o cirugías que pueden haber sido indicados por un médico real, como un vídeo donde en la miniaturas (thumbnails) se lee “Persona mayor, ¡no aceptes esta cirugía!” y “¡Nunca te pongas esta vacuna!”.

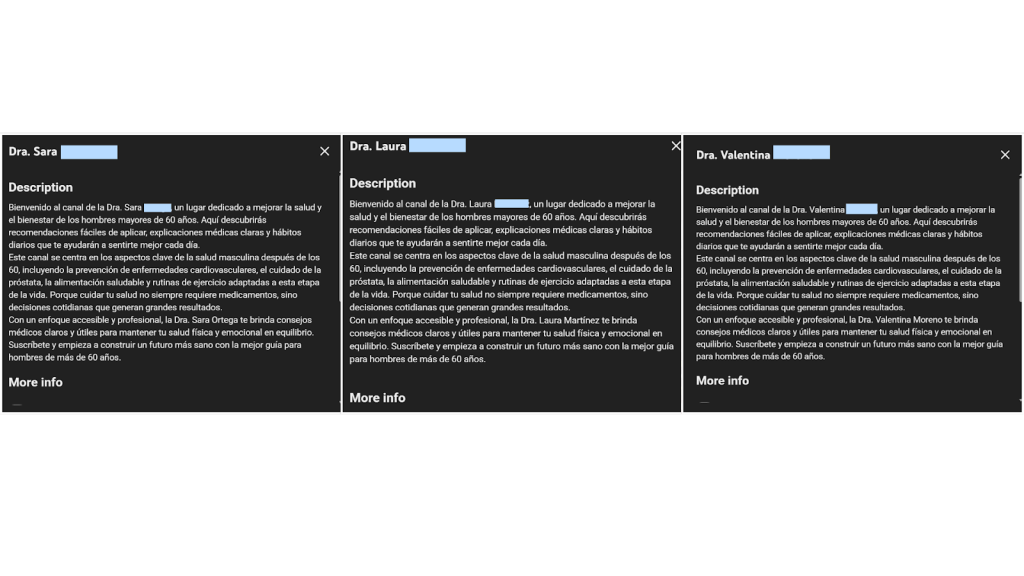

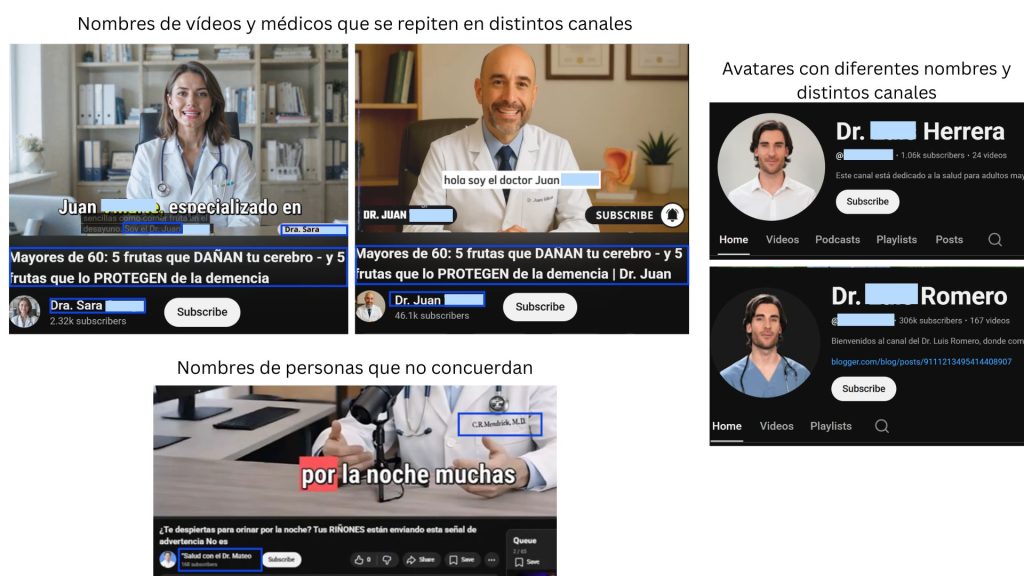

Los vídeos analizados utilizan títulos y miniaturas similares, y muchos de ellos tienen guiones casi idénticos, a pesar de pertenecer a canales diferentes. De hecho, incluso las descripciones de los canales coinciden (tres de ellos tienen exactamente la misma, sólo cambia el nombre del supuesto médico). En estas descripciones, los perfiles se presentan como doctores expertos en envejecimiento y vida saludable. Sin embargo, desde Verificat no hemos podido comprobar que la autoría de las cuentas sea la misma.

Descripciones idénticas de tres de los canales de falsos doctores analizados.

Algunas de las descripciones incluyen descarga de responsabilidad, y recomiendan consultar con un médico antes de realizar ningún cambio en el estilo de vida, pero no hayninguna descripción que incluya una advertencia de que los contenidos están generados con IA. Sin embargo, la evidencia de que no son personas reales es clara.

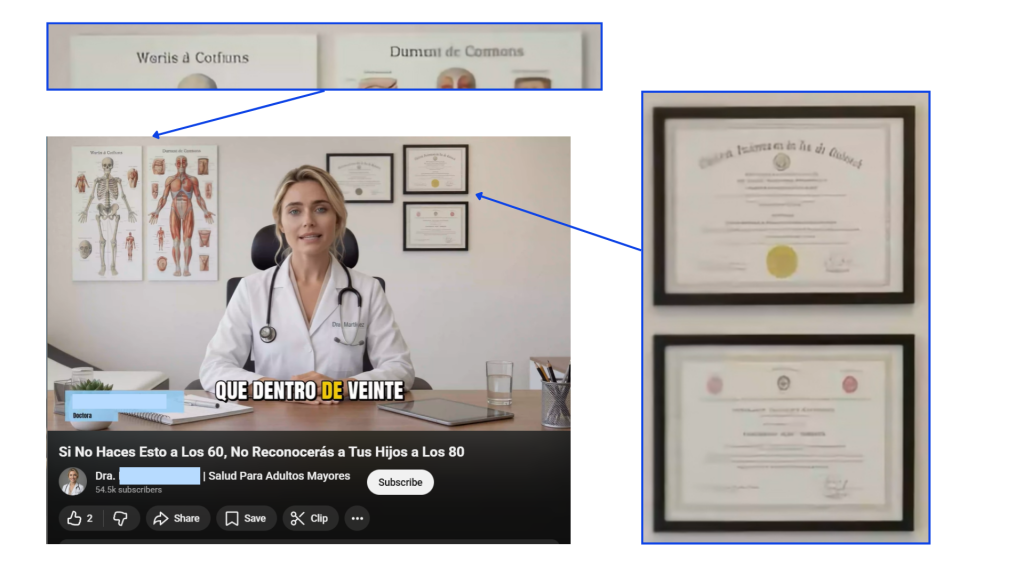

Siguiendo los pasos de la guía de Verificat para detectar contenidos generados con IA, hemos podido detectar, por ejemplo, que varios canales emplean los mismos avatares (las mismas caras, que en algún caso son las de la plataforma HeyGen AI); que hay nombres que no concuerdan entre la presentación que hacen los supuestos médicos del vídeo, el nombre que aparece en la bata (en algunos casos anglosajón) y el nombre de los canales; y que existen letras en algunas imágenes que no corresponden con letras reales del alfabeto, evidencia clara de estar generados con IA.

Ejemplo de un vídeo no etiquetado como “Contenido alterado o sintético” con letras falsas y borrosas que demuestran haber sido realizado con IA.

Ejemplos de nombres, títulos de vídeos y caras que se repiten en distintos canales analizados.

Entre los canales analizados, no hemos encontrado ninguno que suplantara la identidad de una persona real, aunque en otros canales internacionales sí ha pasado, como demuestra la investigación de Science Feedback sobre el fenomen a TikTok.

Tres de cada cuatro vídeos no indicaban que eran IA

Una de las formas de detectar vídeos generados con inteligencia artificial es identificar etiquetas como “generado con IA”. En el caso de YouTube, los creadores deben incluir la etiqueta de “Contenido alterado o sintético» en los vídeos creados de esta manera. De los 962 vídeos analizados, sólo el 26% llevaban esta etiqueta. Así, casi tres de cada cuatro no la mostraban. En ocho de los canales, la proporción de vídeos no identificados como IA está entre el 80 y el 100%.

Según las políticas de YouTube, los creadores deben notificar cuándo emplean la IA para generar «contenido realista» o para hacer «cambios importantes» en un vídeo real. Aquellos “que decidan sistemáticamente no divulgar esta información pueden ser objeto de sanciones por parte de YouTube, tales como la eliminación de contenido o la suspensión del Programa de socios de YouTube”. Desde el departamento de prensa de YouTube explican a fecha 25 de marzo que uno de los 14 canales reportados por Verificat ha sido cerrado por infringir la política de spam, prácticas engañosas y estafas, y han suspendido un número indeterminado de canales del Programa de socios de YouTube por lo que ya no pueden obtener ingresos del contenido.

Desde YouTube aseguran que aplican las normas de la Comunitat “mediante una combinación de aprendizaje automático y revisores humanos” y que “el contenido infractor representó entre el 0,14% y el 0,15% de las visualizaciones” en el cuarto trimestre de 2025. La muestra reducida de canales analizados por Verificat, que publicaban desde hacia meses y acumulaban miles de visualizaciones, solo recibieron las acciones de YouTube después de la revisión de los vídeos que les hicimos llegar.

Por otra parte, la Ley sobre IA de la Unión Europea establece disposiciones para garantizar que las personas puedan saber cuándo un contenido se ha generado con IA. En esta línea, debe publicarse entre mayo y junio de este año un código de buenas prácticas que, pese a no ser de aplicación obligada, pedirá a las plataformas marcar el contenido realizado con IA. En cambio, las normas de transparencia que entraran en vigor l’agost de 2026 sí que obligarán a los sistemas de IA generativa a marcar, en algunas circunstancias, los contenidos que han sido creados artificialmente (Artículo 50).

En declaraciones a Verificat, el departamento de prensa de la Comisión Europea ha señalado que esta normativa prohíbe algunas prácticas, entre las que se incluye la manipulación y los engaños a partir de la IA, y que «los deepfakes y otros contenidos generados por IA deben estar etiquetados como tales».

La desinformación, un peligro para la salud

Todos los vídeos analizados (un total de 962) contienen consejos sobre dieta y estilos de vida para prevenir o tratar enfermedades relacionadas con el envejecimiento como la sarcopenia, la artrosis, la impotencia o las enfermedades cardiovasculares.

También hemos detectado que las falsas doctoras hechas con IA se presentan, a grandes rasgos, como urólogas y expertas en sexualidad, mientras que los hombres hablan de salud cerebral y prevención de múltiples enfermedades. Los vídeos más vistos tienen que ver con los remedios para mantener sanos los riñones, evitar la pérdida de memoria y la demencia, las enfermedades del corazón o la diabetes.

YouTube también tiene políticas contra la desinformación médica en la que especifican que «no permiten contenido que promueva información que contradice a las guías de las autoridades sanitarias en la prevención o transmisión de enfermedades específicas», ni «en tratamientos por enfermedades específicas, incluida la promoción sustancias dañinas específicas o prácticas que no hayan sido aprobadas por las autoridades sanitarias locales». Preguntados por Verificat sobre estas políticas, aseguran que siguen «invirtiendo en el trabajo que hacemos para conectar a las personas en España con información de salud altamente fiable que sea a la vez atractiva y basada en la evidencia».

Hacer de médico es una profesión regulada, recuerda en declaraciones a Verificat Gustavo Tolchinsky, coordinador del programa Web Mèdica Acreditada del Colegio de Médicos de Barcelona (CoMB) y vicepresidente de la Comisión de Deontología del CoMB. “Los colegios profesionales hacen que exista una identificación unívoca de la persona [cualquier médico debe tener nombre y número de colegiado único]”, explica, detalle que no aparece en ninguno de los canales. Añade que el ejercicio de la profesión implica también una divulgación en las redes y en internet dentro de unos criterios regulados, con iniciativas como Web Médica Acreditada o el decálogo del Consejo de Colegios de Médicos de Cataluña (CCMC). En el caso de las cuentas analizadas de falsos médicos realizados con IA, Tolchinsky señala que los vídeos mezclan obviedades con falsedades, “lo que es un peligro”. «Si ves cualquier cosa en las redes, comenta con el médico de cabecera o el especialista para que contraste si es real o no», recomienda.

Un riesgo sistémico en el marco de la DSA

Todos los servicios online que operan en la Unión Europea están obligados a cumplir con la Ley de Servicios Digitales (DSA), un marco normativo que exige que las plataformas minimicen los riesgos de exponer a los ciudadanos a contenidos ilegales y perjudiciales, según detalla la Comisión Europea en su web. Concretamente, el Artículo 34 establece que todos los proveedores de grandes plataformas online “deben identificar, analizar y evaluar diligentemente cualquier riesgo sistémico en la Unión derivado del diseño o funcionamiento de su servicio […] o del uso que se haga de sus servicios”, entre los que se destaca cualquier efecto negativo real o previsible en relación con la salud pública y consecuencias negativas graves para el bienestar físico y mental de las personas.

En un informe del Consejo Europeo de Servicios Digitales de noviembre de 2025, los proveedores de estos servicios reconocieron que hay “riesgos sistémicos para la salud pública derivados de la difusión a gran escala de desinformación en las redes sociales «. «Estos incluyen, por ejemplo, las vacunas, afirmaciones engañosas sobre sustancias y prácticas legales pero potencialmente nocivas, la gamificación de tendencias virales perjudiciales para la salud o enfermedades graves como el Ébola, el VIH/sida o la diabetes», recoge el informe.

L’informe de Google de evaluación de riesgos sistémicos en el marco de la DSA de 2025 pone como ejemplo de desinformación vídeos engañosos en YouTube, comportamientos fraudulentos como el uso de deepfakes o información médica engañosa. «Tomamos medidas para evitar la difusión de este tipo de contenido a gran escala», aseguran.