¿Lees el resumen que ofrece la IA de Google? Comete 75 millones de errores cada hora, según un estudio

Una investigación de ‘The New York Times’ concluye que el 10% de las respuestas de la ‘AI Overview’ son erróneas

Una investigación de ‘The New York Times’ concluye que el 10% de las respuestas de la ‘AI Overview’ son erróneas

Hacer una búsqueda en Google y quedarse con la primera opción que aparece nunca ha sido garantía de obtener la mejor información, ya que el orden de los resultados depende de factores como la publicidad o el SEO, no de la calidad de la información. Ahora lo es todavía menos, puesto que el primer resultado a menudo ya no es una página web, sino un resumen generado por Gemini, la inteligencia artificial de Google.

Una de cada diez respuestas generadas por la función AI Overview de Google comete errores, tal como evidencia una investigación reciente de The New York Times. Que la IA se equivoque no es ninguna novedad, pero ahora el diario estadounidense le pone cifras y evidencia un volumen considerable de imprecisiones: aproximadamente, 500.000 millones de errores al año, 1.369 millones al día o 75 millones cada hora.

El estudio se basa en un análisis encargado a la startup de inteligencia artificial Oumi, que ha evaluado la precisión de las respuestas de Google analizando 4.326 búsquedas en dos fases distintas: primero, con el modelo Gemini 2 y, después, con su versión actualizada, Gemini 3. Los resultados muestran que las respuestas son correctas en aproximadamente el 85% de los casos con Gemini 2 y en el 91% con Gemini 3.

¿Qué son las AI Overview?

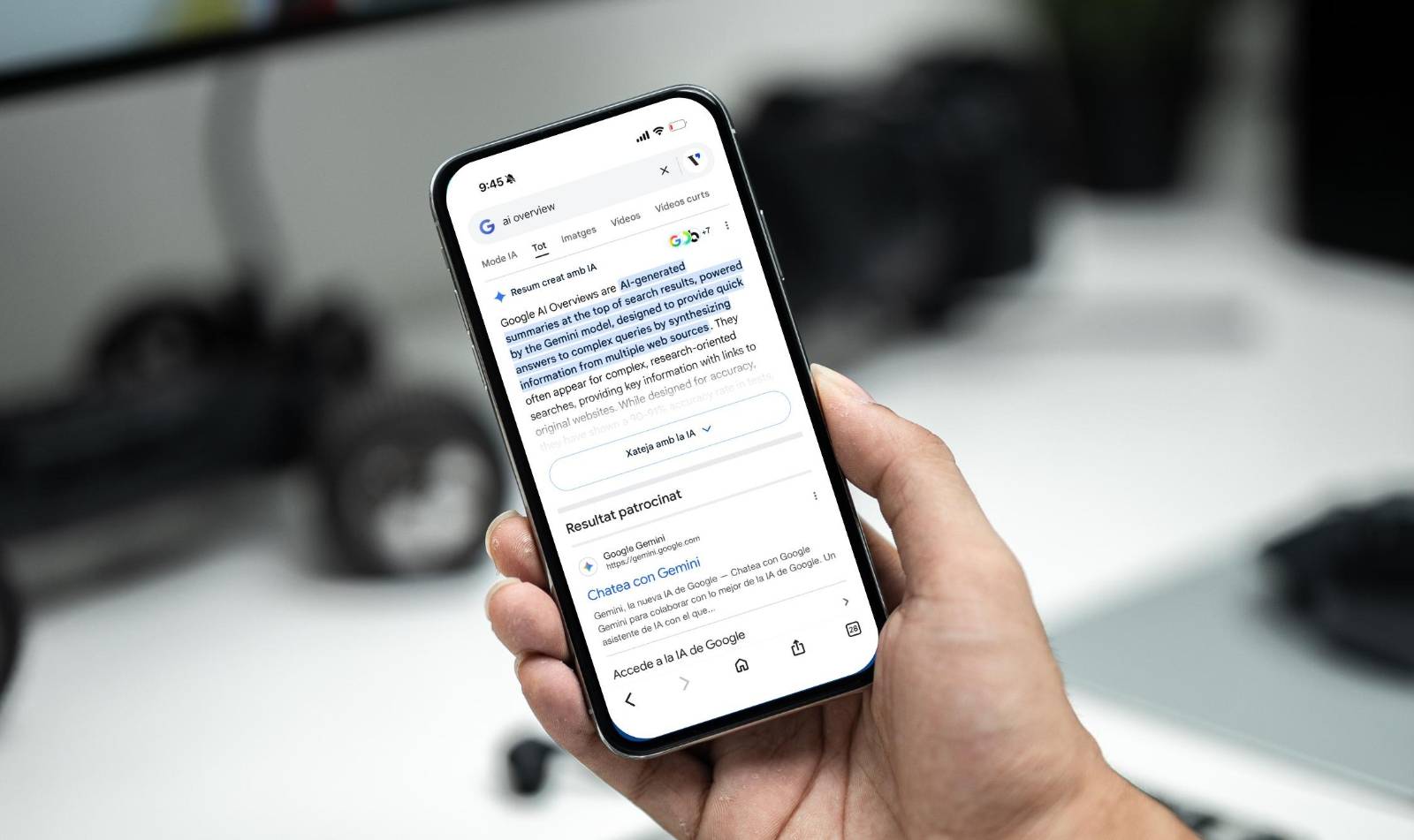

Las AI Overview (AIO, por sus siglas en inglés) son resúmenes generados automáticamente por modelos de inteligencia artificial (concretamente, por Gemini) a partir de la información extraída de varios sitios web. Este contenido se muestra destacado en la parte superior de los resultados de búsqueda, por encima de los enlaces tradicionales. No se trata de una funcionalidad opcional: aparece de manera automática en determinadas búsquedas y forma parte del funcionamiento habitual del buscador.

En España, las AIO se activan en el 28,9% de las búsquedas analizadas. Es decir, casi tres de cada diez consultas muestran un resumen sintético antes de los resultados orgánicos tradicionales. Así lo evidencia el estudio “El impacto de AI Overview en los medios españoles” de la Universitat de Barcelona (pendiente de publicación). En un contexto más global, algunos informes apuntan a porcentajes que se sitúan por encima del 20%, pero otros indican que pueden llegar hasta el 50%.

Fuentes poco fiables y respuestas contradictorias

La investigación de The New York Times detecta problemas relevantes en los resúmenes de IA respecto a las fuentes: más de la mitad de las respuestas correctas no están bien fundamentadas (concretamente, el 56% con el modelo Gemini 3, el más avanzado). Esto significa que los enlaces proporcionados no recogen completamente la información que se presenta.

Ejemplo que ilustra la investigación

Además, la investigación apunta que las fuentes utilizadas no siempre son fiables. Plataformas como Facebook o Reddit aparecen a menudo entre las referencias, también en respuestas incorrectas. Además, el sistema puede generar respuestas dispares para una misma consulta en momentos diferentes, hecho que dificulta su verificación.

En esta línea, en enero de este año, The Guardian ya publicó una investigación propia sobre los resultados engañosos que estos resúmenes ofrecen en temas de salud. Tras dicha investigación, Google decidió eliminar los resultados para las búsquedas “cuál es el rango normal para los análisis de sangre del hígado” y “cuál es el rango normal para las pruebas de función hepática”. Ambas, consultas que la investigación del diario británico había demostrado erróneas.

AI Overview no es lo mismo que el “modo IA”

El buscador de Google también tiene otra opción que utiliza la IA: el modo IA. Disponible en España desde el pasado octubre, se trata de una funcionalidad que ofrece una experiencia más conversacional al usuario, tal como expone Google en su web, con un funcionamiento más parecido a los chatbots.

En este caso, no aparece automáticamente en la parte superior de la página de respuestas, sino que está disponible en la barra de herramientas del buscador. Google asegura en su Centro de Ayuda que siempre “se verifica la información en más de un lugar” pero, como cualquier modelo de IA, “puede no brindar respuestas acertadas”.

¿Por qué fallan estos sistemas de IA?

Según explica Google, tanto las AI Overviews como el modo IA no funcionan con un único sistema cerrado, sino que combinan diferentes modelos y técnicas. Esto hace que las respuestas puedan variar en función de la consulta y del momento, sin seguir un patrón fijo.

La investigación del New York Times apunta al propio funcionamiento de los sistemas de inteligencia artificial. Tal como recoge el diario, estos modelos “utilizan probabilidades matemáticas para adivinar la mejor respuesta, no un conjunto estricto de reglas definidas por ingenieros humanos”. Esto implica que, por definición, siempre habrá un cierto margen de error, tal como se ha explicado.

Además, el estudio detecta que los errores no solo provienen de fuentes poco fiables, sino también de la manera en que la IA interpreta la información. En algunos casos, el sistema es capaz de identificar fuentes correctas, pero hace una lectura errónea o incompleta. Casos como los señalados por Full Fact, que ha advertido que los fragmentos automáticos pueden desinformar, o por The Verge, que ha denunciado cambios en titulares que distorsionan el sentido, ejemplifican cómo estas tecnologías pueden alterar el significado original de la información incluso cuando parten de fuentes fiables.